Recentemente, algumas pessoas da Comunidade Slack indicaram que nossos princípios de privacidade publicados não eram claros o suficiente e poderiam gerar mal-entendidos sobre como usamos os dados dos clientes. Sua opinião é muito importante e, ao analisarmos o texto em nosso site, percebemos que vocês estavam corretos. Poderíamos ter explicado nossa abordagem de maneira mais direta, sobretudo no que diz respeito às diferenças no uso de dados em modelos tradicionais de aprendizado de máquina (ML) e na IA generativa.

Hoje, atualizamos esses princípios para explicar com mais simplicidade como o Slack protege os dados de clientes, ao mesmo tempo em que oferece experiências de ML e IA generativa na plataforma. Confira o que você precisa saber:

- O Slack usa técnicas de aprendizado de máquina padrão do setor que protegem a privacidade de recursos como recomendações de canais e emojis, além dos resultados de pesquisa. Não criamos nem treinamos esses modelos para aprender, memorizar ou reproduzir qualquer tipo de dado do cliente. Mesmo que os usuários possam optar por desativar essas ferramentas, os modelos tornam a experiência do produto melhor para todos, sem o risco de seus dados serem compartilhados. Os modelos tradicionais de ML do Slack usam dados agregados e desidentificados, e não acessam o conteúdo das mensagens em MDs e canais privados ou públicos.

- O produto de IA generativa complementar do Slack, a IA do Slack, utiliza LLMs de terceiros. Nenhum dado do cliente é usado para treinar modelos de LLM. Além disso, não desenvolvemos LLMs ou outros modelos generativos usando dados do cliente.

A confiança é o nosso principal valor e ela começa com a transparência. Nossos clientes merecem uma explicação cristalina de como usamos (e, mais importante, de como não usamos) dados de clientes para oferecer a melhor experiência possível no Slack.

Esta postagem se aprofundará para esclarecer ainda mais o tema. Esperamos que isso ajude e, como sempre, valorizamos a sua opinião.

Proteção dos dados: uso de modelos tradicionais de aprendizado de máquina pelo Slack

A missão do Slack é tornar a vida profissional das pessoas mais simples, agradável e produtiva. Com tanta informação disponível na plataforma, encontrar o que você precisa com rapidez é essencial para um bom desempenho. Desde 2017, usamos técnicas de aprendizado de máquina que protegem a privacidade e seguem os padrões do setor para mostrar as informações certas ao usuário certo no momento certo. Por exemplo, essas técnicas ajudam a autocompletar nomes de canais enquanto você digita na pesquisa ou recomendam novos canais para você participar dentro do seu workspace.

Nossos Princípios de Privacidade orientam o uso do aprendizado de máquina no Slack. Publicamos essas diretrizes para o público externo a fim de garantir transparência e responsabilidade. Esses princípios estão alinhados com o compromisso histórico do Slack com a privacidade de clientes e usuários. Eles asseguram que:

- Os dados não vazam entre workspaces. Não criamos nem treinamos modelos de ML para aprender, memorizar ou reproduzir dados do cliente.

- Os modelos de ML nunca acessam diretamente o conteúdo de mensagens ou arquivos. Em vez disso, eles se baseiam em recursos numéricos cuidadosamente derivados. Por exemplo:

- Um registro de data e hora da última mensagem enviada em um canal pode nos ajudar a recomendar seu arquivamento para simplificar as barras laterais dos usuários.

- O número de interações entre duas pessoas é incorporado na lista de recomendações de usuários. Assim, quando um usuário inicia uma nova conversa, recebe uma lista relevante de colegas de trabalho com quem interagir.

- O número de palavras em comum entre o nome de um canal e outros canais dos quais o usuário é membro pode indicar a relevância desse canal para ele.

- Controles técnicos previnem acesso não autorizado. Ao desenvolver modelos de IA/ML ou analisar dados do cliente de outra forma, o Slack não acessa o conteúdo subjacente. Tomamos diversas medidas técnicas para impedir que isso aconteça. Leia nosso White paper sobre segurança para saber mais sobre esses controles que protegem a confidencialidade e a segurança dos dados do cliente.

- Os clientes têm poder de escolha nessas práticas. Se você prefere que seus dados não sejam usados para treinar os modelos de ML do Slack, pode optar por desativar o recurso, conforme documentado aqui. Como implementamos fortes proteções para treinar esses modelos com segurança e oferecer a melhor experiência possível no produto, por padrão a opção de desativação não está disponível nos workspaces.

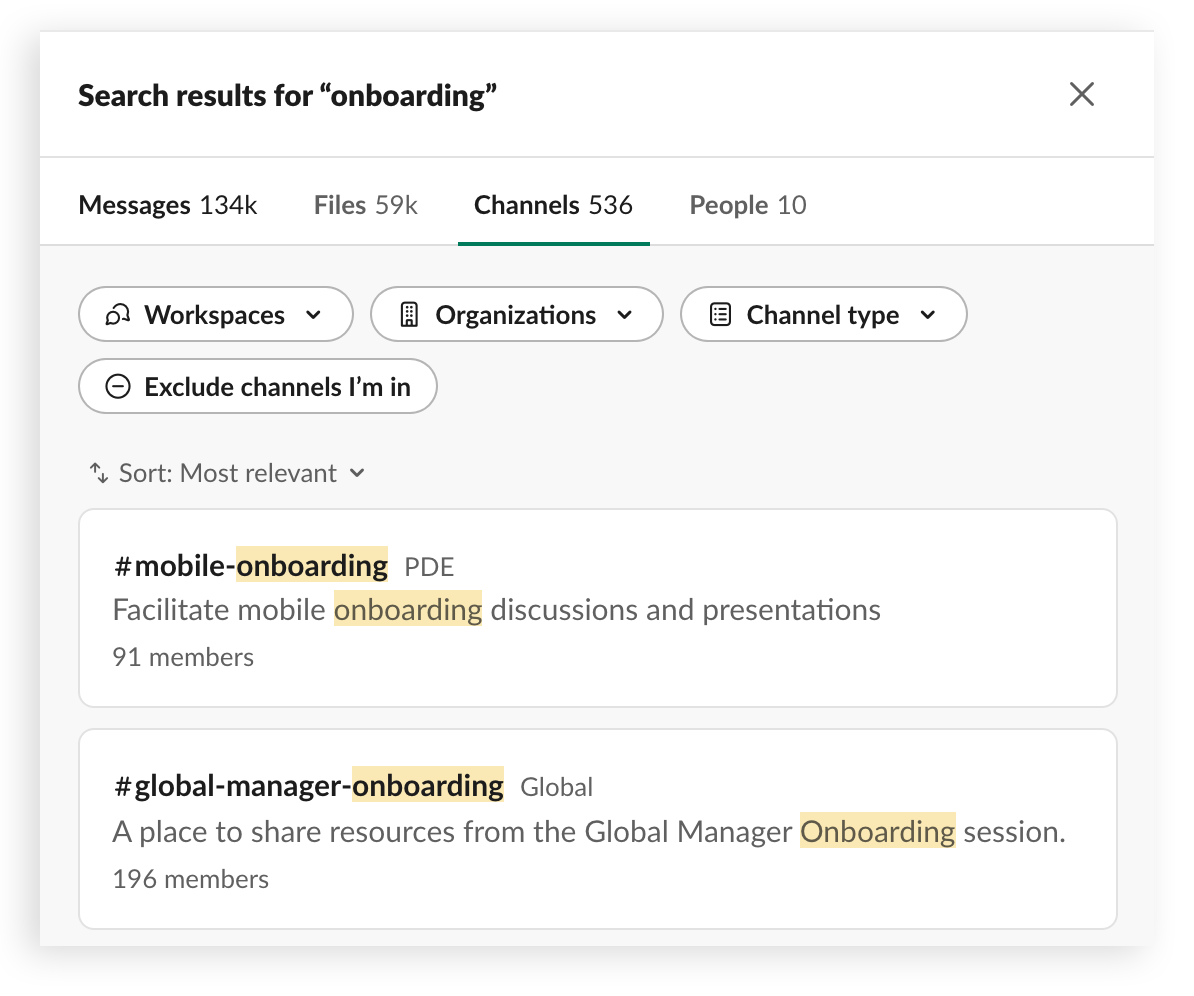

Confira alguns exemplos específicos de como modelos de ML não generativos são usados no Slack para facilitar a localização do que você precisa:

Classificação da pesquisa

Cria uma lista priorizada e personalizada de resultados quando um usuário pesquisa por pessoas, mensagens ou arquivos.

Como funciona:

Nossos modelos de aprendizado de máquina para pesquisa ajudam usuários a encontrar o que procuram, identificando os resultados corretos para uma consulta específica. Fazemos isso com base em resultados de pesquisas anteriores e interações passadas, sem aprender com o texto subjacente da consulta de pesquisa, resultado ou proxy. Em outras palavras, nossos modelos não são treinados com a consulta de pesquisa real, mas aprendem com o contexto da pesquisa, como o número de palavras em uma consulta.

Recomendações

Recomenda usuários, canais, emojis e outros conteúdos relevantes em vários lugares do produto, como as sugestões de canais para você participar.

Como funciona:

Muitas vezes, recomendamos que usuários entrem em novos canais públicos do workspace para que possam aproveitar o Slack ao máximo. Essas sugestões são baseadas na participação em canais, na atividade e nos assuntos em comum. Fazemos isso de forma que preserve a privacidade, utilizando modelos de ML de código aberto que não foram desenvolvidos com dados do Slack em momento algum, com o objetivo de avaliar a semelhança entre os assuntos e gerar pontuações numéricas. Nosso modelo faz recomendações baseadas apenas nessas pontuações numéricas e em dados que não são do cliente.

Preenchimento automático

Ajuda a adicionar usuários, canais e nomes de arquivos a mensagens usando o cliente de pesquisa do Slack.

Como funciona:

Quando usuários querem mencionar um canal ou usuário em uma mensagem, eles começam digitando # e o início do nome. Nossos modelos sugerem os canais mais relevantes que eles podem estar procurando com base em uma série de fatores, incluindo canais dos quais o usuário é membro e suas interações recentes e frequentes.

Em suma, os modelos tradicionais de ML do Slack usam dados agregados e desidentificados e não acessam o conteúdo original das mensagens em MDs e canais privados ou públicos para fazer essas sugestões. Em vez disso, eles coletam dados agregados para melhorar a pesquisa, fazer melhores recomendações e sugerir recursos relevantes.

Desativação do cliente e experiência do usuário

Clientes podem enviar um e-mail ao Slack para solicitar a exclusão dos seus dados do treinamento de modelos de ML não generativos. Feito isso, todos os dados associados ao seu workspace serão usados apenas para melhorar a experiência dentro do seu próprio workspace. Você ainda desfrutará de todos os benefícios dos nossos modelos de ML treinados globalmente, sem contribuir para os modelos base. Nenhum recurso do produto será desativado, mas alguns locais onde os usuários podiam fornecer feedback anteriormente serão removidos. É provável que os modelos globais tenham um desempenho um pouco inferior na sua equipe, pois qualquer padrão distinto no seu uso deixará de ser otimizado.

Em outras palavras, o impacto para um cliente que opta por desativar deve ser mínimo. No entanto, quanto maior o número de clientes optando pela desativação, pior será o desempenho geral desses tipos de modelo.

Eis a IA generativa

A IA generativa introduz uma nova categoria de modelos para melhorar a experiência do usuário: os grandes modelos de linguagem (LLMs). Os LLMs são usados na IA do Slack, um produto complementar adquirido separadamente. Desenvolvemos a IA do Slack priorizando a segurança e a confiança, adotando as seguintes medidas:

- Os dados do cliente nunca saem do Slack.

- Não treinamos LLMs com dados de clientes.

- A IA do Slack trabalha apenas nos dados que o usuário já pode ver.

- A IA do Slack atende a todos os requisitos de segurança e conformidade de nível empresarial do Slack.

O Slack não treina LLMs nem outros modelos generativos com dados do cliente, nem compartilha dados do cliente com qualquer provedor de LLM.

Leia mais sobre como criamos a IA do Slack para ser segura e privada aqui.